西方哲学有一个很重要的流派,是逻辑语言分析哲学。它隐含的内在假设是世界是有客观真理,人类语言把客观真理给映射表现出来。人类通过语言这一面透镜,可以认识背后底层的客观真理。那么哲学的任务不是解释世界,而是澄清语言,从而澄清思想与逻辑。

代表性的有维特根斯坦的逻辑哲学论,鲁道夫·卡尔纳普的维也纳学派。

德国—奥地利的语言分析传统,包括最早的戈特洛布·弗雷格,到后来的维也纳学派,他们都认为语言反映了世界本体。比如说若某个名词具有复数形式,意味着客观来说这个单词对应的是可数的、可进行数运算的;若某个动词具有主动被动格,意味着这个动作在根本上必须是有主体和对象的,这种结构(也是反映了世界的结构)至少允许包含行动者和承受者。因此,对语言的分析可以暴露我们的世界的根本假设,进而推导出未被语言所明说的东西(新的知识)。

维特根斯坦提出了一个概念叫做命题proposition,指的是一种可以判断真假的意义内容,跟文字形式无关的实体。比如,中文说雪是白色的,英文说Snow is white,德语说Schnee ist weiß,背后表达的是同一个命题。也就是说,命题是跨语言的,语言只是命题的形式载体。反过来,有很多句子无法判断真假,那么就不是命题。比如说,“好白呀!”这种是抒发感叹、“要是明天下午多好”这种是许愿,都不属于命题。

命题的意义,就在于它描绘了一种可能的事实。命题为真的意思,就是对应的事实存在;命题为假,就是对应的事实不存在。这就是所谓的语言反映世界。

我们喜欢从语言文字上出发,去研究一个词语的概念,给这个概念下定义,抽丝剥茧地分析这个概念的性质。这就是分析哲学的思路,一旦完成了定义和分析,就可以直接进行延伸推论,因为我们认为通过定义和分析的方法,已经掌握了底下隐含的真理。

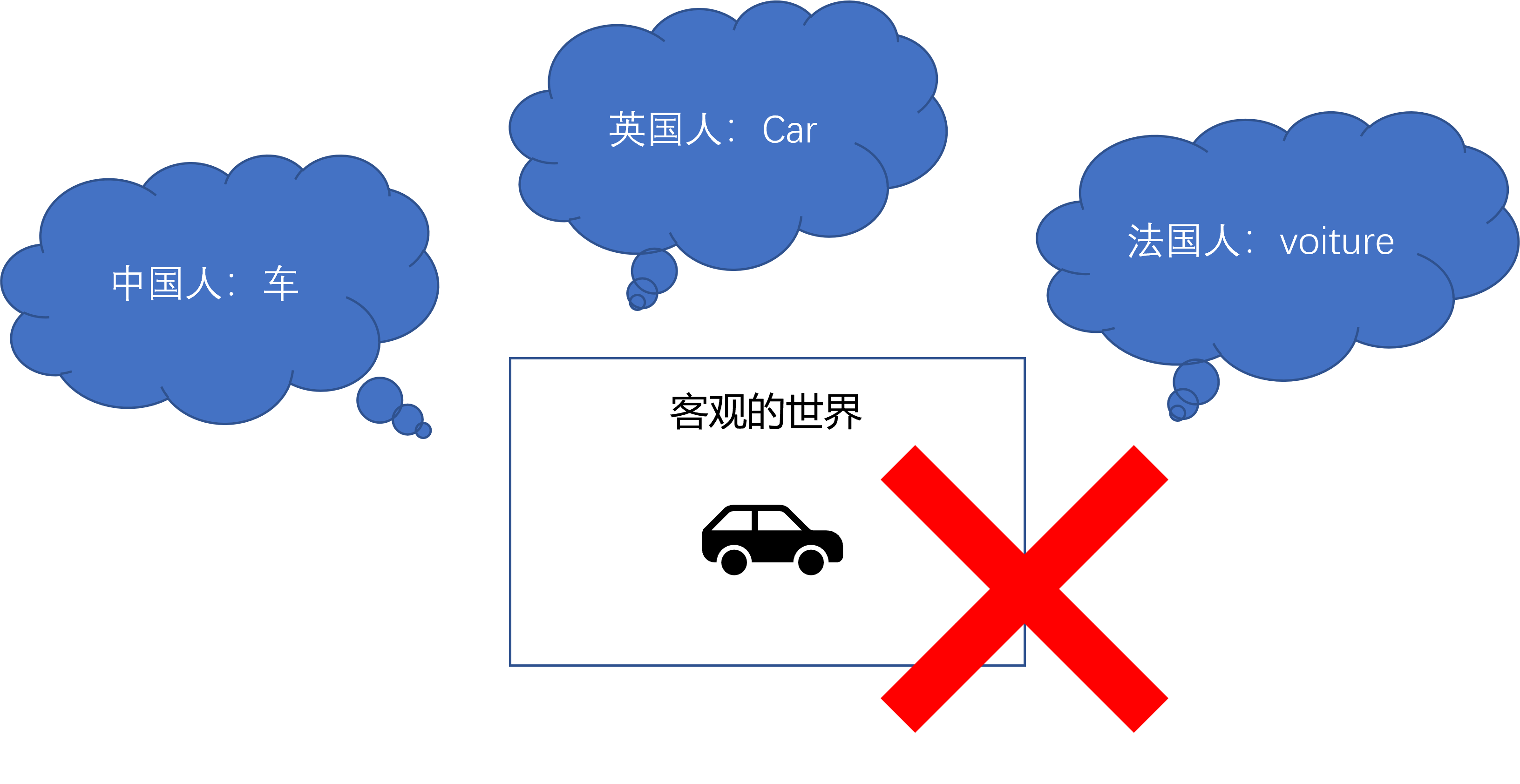

我们来分析一个单词:车。英文叫car,法语叫voiture. 在英汉词典、英法词典中,它是一一对应的词语。那么,是不是说明它背后指代出来的概念其实是一个东西?

并不是。

Car指代的是四轮(两轮的不能叫car,叫bike)、至少有一定封闭箱体(平板货车不能叫car)、私用的交通工具(公交车不能叫car)。voiture更严格一些,在car的基础上,增加了家庭使用且进行正式道路注册的意思,法语的voiture包含了“被国家允许在公共道路上行驶的私人机动车”的概念。如果没有被注册允许,那么只能叫做véhicule.

但是中文的车,意思就更广泛了。只要有轮的就叫车。

这三个词的概念不同,跟文化历史渊源有很强的关系。

中国的车出现得很早。考古的文献表明,中国早在商周时期就认识到用轮子可以制作交通工具,尤其是战车。到了春秋战国时期,车不仅是战争武器,还是政治、礼制、交通的核心工具,秦始皇甚至需要专门颁布规则车同轨,书同文。车这个概念的出现,是纯工程技术的描述,早于国家制度、早于各种用法。

法语的voiture直到18世纪才出现。在欧洲,马车在城市大规模普及,公共道路密集化,城市事故、税收、治安问题爆发,国家(尤其是法国)开始系统接管道路。Voiture大量出现在行政法规的文本中,因此法文的voiture背后的制度认证含义更强。

英国car的来源就更晚了。当欧洲大陆马车盛行,并且被国家法制强力规范的时候,不列颠群岛上并没有这么先进的马车系统和交通系统。英国很多还是秉持着骑士精神,英文的car被广泛使用的时间更晚,直到20世纪初汽车革命的出现,才被广泛运用,特别是1896年。早在1796年工业革命,蒸汽机就被发明了,自然也已经出现了汽车。但是当时并不叫car,而是叫steam carriage(这才是真正的“汽”车的原始翻译来源啊!)。等到1885年卡尔·本茨(对,就是奔驰汽车的发明人)发明了内燃机,才解决了可量产、可日常使用、专为道路行驶(而不是铁轨),之后这种交通工具才被叫做car。

从法语voiture和英语car的不同来源,还能引申出一个有意思的事情——为什么英国交通法规是靠左行驶,而欧洲大陆是靠右行驶,全球的交通法规无不延伸于这两者。

有趣的是,归根结底的原因都是因为大部分人是右撇子。

因为以法国为代表的欧洲大陆道路交通法规,是在18世纪就完成了。那时候是马车的时代,马车夫需要用右手拉住缰绳控制马匹,所以习惯让马在右边,车夫在左边控制着马,而车夫也从左边容易下车和观察前方的道路。

而英国没有那么大的马路(马路这个词也来自于欧洲大陆,指的就是马车走的路),路上主要是骑马的人。骑士倾向于右手拿武器攻击对面来的人,所以马要靠左走。于是英国就逐渐形成了靠左行驶的习惯。

从上面这个例子可以看出,语言并不是反映底层一个客观的概念,而是跟社会历史文化的渊源有强关。一个具体词语所表达的意涵所指,反映的就是社会文化这些上层建筑。就打个比方,当人们通过语言文字去理解概念,以为是通过一个玻璃透镜去研究底层的东西,殊不知他其实是通过万花筒在看,你看到的图案不是世界本身,而是这个万花筒呈现出来给你。

也就是说,你对一个词语概念钻得越深,对它的定义跟它的外延研究得越深,其实你只是在研究产生这个词语的社会文化本身。

而文化本身是流变的。

如果你知道你研究这个词汇的本意是在研究文化,那完全没问题。如果你把研究这个词语的概念当成探究世界本源的方式,那就有大问题。

Context在人与人之间交流的重要性就体现出来。假设一个中国人和一个法国人在讨论新能源车的创新。中国人说,我们可以搞一个新能源的无人车,这无人车它不上路,只在物流仓库内部使用。法国人就会觉得,你在说啥,你根本就没有在谈论voiture,不上路的就不叫voiture。

中国人说,为了讨论方便,让我们定义一下,车就是带轮子的交通工具,不管它上不上公共道路,只要它能运输就好。那法国人说那叫vehicle,但是vehicle你为什么要定义加个轮子?现在物流仓库里面用的吊篮也挺好,为什么不能直接用吊篮?

那解决这种方式只有两种方法:

第一是对齐context,但这可能会花费非常多的时间,最后也对不齐。

第二种方法,马斯克说的第一性原理。咱们就不要纠结在车这个概念去进行讨论,而是讨论一个有轮子的装载工具,至于为什么要轮子,是因为轮子是目前效率最高成本最低的省力杠杆,我们只是把这种最佳的省力杠杆,从家用汽车扩展到其他有运输需求的场景中。如果你要推翻轮子进行创新,那么我们可以来研究,哪种装置能够达到更高的省力效率。

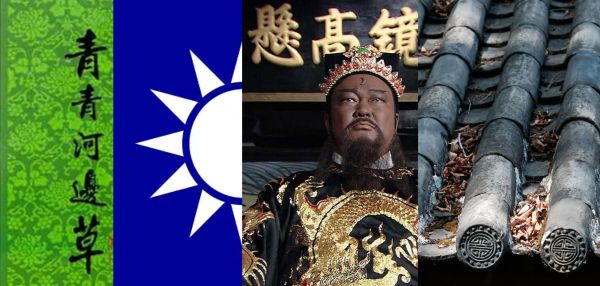

我想展开一下对齐context究竟有多难,刚刚只是举了不同语言的一个例子。我再举一个都是中文的例子:青究竟是什么颜色?

青青河边草,是绿色。

青天白日旗,是蓝色。

君不见,高堂明镜悲白发,朝如青丝暮如雪,是黑色。包青天也是黑色。

青瓦/青铜,是深灰色。(小知识,紫禁城里有一些建筑的顶上是绿得发亮的瓦片,那些叫琉璃瓦,不是青瓦)

好。现在来了,有多少人会认为,“绿水青山”表示要把山种满绿色植物?

实际上,青山并不是指植被覆盖绿色(至少在之前的用法中),而是指稳定、厚重、远观为暗色的地形整体。闭上眼睛,可以想象水墨画中用黛青描绘出的远山阴影,那就叫做青山。直到最近十年,在绿水青山就是金山银山口号的灌输下,大家普遍都认为要种树、要守绿、要发展和保护森林免受工业破坏。因此人们越来越觉得青山的青表示绿色,而不是水墨画的黛黑色。

如果请你给青色下个定义,绝不绝望。

回到维特根斯坦的解法,他认为,语言文字不仅仅能对一个事物做定义,还能分析事物之间的关系——也就是事实。维特根斯坦认为事物之间的联系,比起孤立的事物本身,更体现世界的本质。世界是事实的总和,而非事物的总和。这个思想挺接近佛教的“缘起性空”中缘起的那部分。所谓事实,就是事物之间以某种方式成立的关系。

语言之所谓可以成为研究世界的透镜,是因为语言命题的结构,与事实的结构在逻辑上是同构的。命题是现实的图像。

比如,命题结构:主语+谓语+状语,反映了世界结构:对象+属性+关系/状态。

命题能够直接描绘事实,是因为命题和事实共享同一种逻辑形式。“能被显示的,不能被说出。”意思就是语言已经显示出它的逻辑形式,这种逻辑形式无法再用其他命题来描述,否则就会自指塌陷。

我们用“雪是白色的”来进行逻辑分析,首先,它是一个命题,因为它可以判断真假;其次,这个命题描绘了一种可能的事实结构,“雪”是主语,表示对象,“是白色的”是谓语,表示状态。这句话的真假,取决于世界的结构是否与语言相符。如果这个世界,对于对象【雪】,其【颜色】这个状态为【白】。这个命题结构就展开成 雪.颜色() = 白色. 或者 Color(Snow) = White. 这个命题为真的条件,就是世界正是以语言描述的同样的结构成立。我们并不是在追问雪的颜色是不是白色,而是在看世界现在是不是以“雪-如此这般-白色”这种结构呈现。

具体而言,“雪是白色的”这个命题什么时候为假呢?当雪被煤灰覆盖、或者雪地战场被血染红,雪呈现黑色/红色,那么“雪是白色”就为假。当然还有其他两种极端情况,比如雪其实不是雪(而是盐)、雪其实不存在,这个命题也会不成立。不过后两种情况更接近null,而不是false.

但是,白色有没有定义重要吗,如果没有明确定义,如何处理一些白得不够白的情况,它算命题为假吗?比如微微发灰的雪,夕阳下反射出红色的雪。维特根斯坦并不处理这种情况,它认为这是语言使用边界的问题。如果我们在日常的语言实践中仍然会说它是白色(也就是说世界确实如此),那么命题就为真。如果我们日常的语言实践说它已经不是白色了,那命题就为假。

所以,我们通过语言的分析,就得到世界的最小单位,并不是“雪”和“白色”这样的概念,而是雪是以如此方式成立的结构。结构并不涉及对雪的定义,也不涉及对白色的定义。

而我们对雪这个概念和白色这个概念的追寻,其实是在追寻我们日常语言的习惯。我们花再多的力气去挖它的本质,挖到最后,其实也是在挖我们的习惯或者社会共识。如果我们对概念分析跟语义分析抱有超出这种目的的期待,比如说期待去映射到世界的本质,那就陷入自指塌陷了。

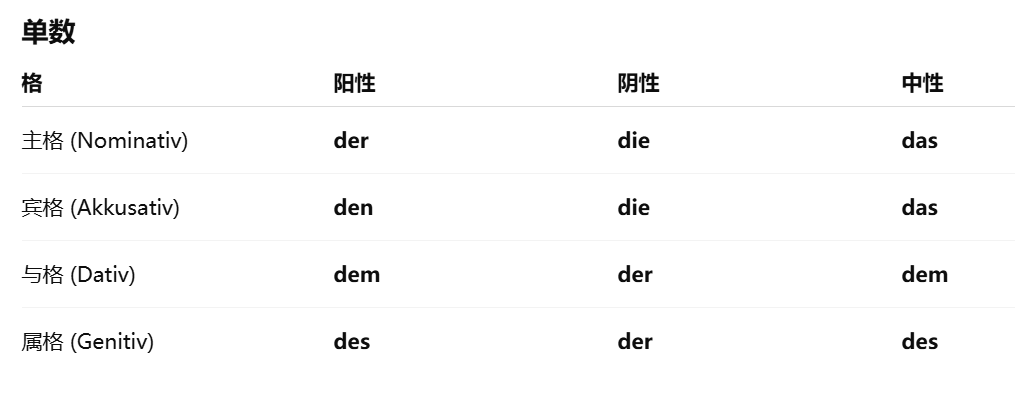

可以看到,逻辑分析这一流派的哲学,为什么是从欧洲大陆,特别是德国-奥地利的哲学家中出现,跟德语这门语言有莫大的关系。德语被称为最严谨的语言,有几个特点。

第一,德语的结构先于内容。英文和中文往往着重在内容上,德语则是先立结构,再往里填内容。动词决定句子逻辑,经常使用从句套从句,从句动词堆在最后。一个句子必须等到最后一个动词才能知道整句话的逻辑,强迫听者不要如意识流般吸收内容,而是要在脑中持续维护一个尚未完成的逻辑结构。

第二,德语名词有三性两数四格。英文一个the,德语丧心病狂,要分成9种说法,见下表。每一种不同的冠词,都在暗示名词的性质、状态和动作。

正是德语的这种特点,才造就了德国-奥地利哲学家的逻辑语言分析倾向。这种倾向在英美和中国哲学家中都极其少见。有讽刺意味的是,逻辑分析哲学家试图跳过语言的表面形式,去理解世界本质。但结果,他对世界本质的这种结构性理解,还是受限于他自己的语言形式本身。

我们今天重新拾起这个话题来讨论为什么还有意义,是因为AI的发展,给了我们新的物料来讨论,反过来这个讨论的结论也许对LLM的发展也有新的意义。

跟ChatGPT 的对话给我很大的震撼,它不是原来Siri或者小爱的那种智能,明显感觉是有一个算法来把我的文字转化为内嵌的各种语义,然后再有一个算法来执行指定任务,最后用TTS的方式合成语音告诉我。这些语音智能助手的任务是有限的,是被提前指定好的,当我提出的任务超过了预先指定的这些任务时,Siri 只能说Sorry, I don’t understand.

但是ChatGPT,展现了超强的概念理解能力。它给我的感觉是,它不仅仅是被预先编程好的一段程序,而是真的在理解我所说的话,以及我这句话背后的概念,并试图跟我进行交流。

ChatGPT并没有靠研究人员给他先验地写入关于世界的知识,没有显示地提供概念的信息,也没有提供在线检索的功能。研究人员仅仅给他搭了个框架,就是所谓Transformer的框架,然后就把海量的人类文本数据灌进去训练。因此,模型的能力只可能学到文本本身的统计和形式结构。这个模型不可能学会概念本身的定义,以及世界的因果关系。

但是ChatGPT确实让我感觉他真正理解了概念。从现象学的角度来说,ChatGPT是不是真正学会概念本身可能并不重要。英文有一句俗语,如果一直动物,看起来像鸭子、走起来像鸭子、叫起来像鸭子,那它就是鸭子。有没有一种可能,人类其实也是通过语言文本本身的统计和形式结构来理解概念的,就像逻辑语义分析的先哲们干的一样?有没有一种可能,理解概念,跟掌握这个词在文本中的用法,就是同一件事情?

激进地说,就是同一件事情。所以不用纠结ChatGPT能不能理解概念。他既然把概念用对了,他就是理解的。

经典的色盲悖论就是最好的证明。

想象有一个人,他有一种奇怪的色盲症,他天生看到两种颜色跟正常人的刚好相反,他会把红色看成绿色,把绿色看成红色。那么问题来了:第一:如何才能证明他所看到的颜色和别人是不一样的?第二:你怎么证明你不是上述故事中的这个人?

有人说,太简单了,拿片绿叶问他是什么颜色。如果他说红色,就证明他不一样。红绿色盲不就是看色卡测试的么。

不对,这样是测不出来的,他仍然会正确地回答绿色。因为他从小就被人灌输了叶子是绿色的,花是红色的,所以他理所当然的就称呼他看到的那个叶子的颜色为绿色。同时,他也会将所有与他认识中叶子相同的颜色称为绿色。

所以,这个悖论的答案就是:一、他不会在任何可观测的行动上跟别人不同,他就是一个完完全全的正常人;二、无法证明。

可以在网上搜索“色盲悖论”,很多网友会对这个结论非常震惊,并且提出各种升级的解决方案,比如利用色/光谱、利用波长、测试他的视细胞和基因等方法。但这些方法都可以被很容易地证伪。

色盲悖论的结论就是:其实世界的真相,也许每个人都是这种颠倒色盲患者,同样的颜色在不同人的视细胞的激活方式就是千差万别的。但是由于人们在学习语言的过程中,学习到这些颜色与颜色之间的关系和形式结构,因此掌握了表示这些颜色的词语。他不需要证明他自己的真实体验是不是红色,只要他可以把红色这个词语用对,就等于他真实体验了红色。

把色盲悖论的结论用在LLM身上,为什么要去追问LLM底层是不是真正把握了概念,如果LLM能把词语用好,那么我们就可以直接认为LLM已经能理解概念了。

我们反过来考察我们通常理解的词语和概念。回到刚刚举的“雪”这个概念。字典里它的定义是:“指从混合云中降落到地面的雪花形态的固体水。雪是水在空中凝结再落下的自然现象,或指落下的雪;雪是水在固态的一种形式。”人们会认为雪这个词表示的是一种自然界就存在的客体,语言只是给这个客体赋予一个名字和发音,这是一个主客观对应的映射。人们会认为“雪”这种自然概念,跟“春节”这种社会概念有很大的区别,前者是客观物,后者是人类社会的构建物。

但是,既然词语的形式和结构等于概念的本体,而词语的形式和结构又是通过大量文本的统计中学到的,那么词语就不存在一个底层对应的客观存在的客体,所有的词语(包括那些描绘客观概念的词语)都是纯粹的人类文化构建物,进而,所有的概念都是纯粹的人类文化构建物。

也就是说,其实世上本没有雪,说的人多了,也便成了雪。

为了理解这句话,我要搬出不同语言做镜子了。

中文的鹿,是一种动物。梅花鹿、麋鹿、驼鹿是亲戚,鹿跟马是不同的动物,否则不会有指鹿为马的成语。但是你指着梅花鹿跟中国人说它是鹿,指着麋鹿说是鹿,那完全没问题。但是英文中的鹿,包括deer, moose, elk, reindeer……没有一个英文的名称可以涵盖中国的“鹿”。我们可以反问一下,为什么我们会觉得梅花鹿、麋鹿是同一物种,但是英国人并不觉得?

连自然概念这种高度客观的概念,都高度依赖语言的切割分类。

反过来,英文的Agent,中文并没有同一的翻译。既包括FBI特工,包括房产中介,包括计算机网络代理,包括AI的智能体。

实际上,在英文中,agent是一个高度稳定、跨语境复用的概念单位。它并不要求对象像人,也不要求具备某种特定的功能,而是:“能够代表某个系统,发挥某个作用、引发某种变化的行动源头。”

FBI特工,就不等于间谍。中文间谍这个词是从这个人执行的任务、发挥的功能出发的,侧重他的情报作用,暗示他的秘密性。但是特工这个词并没有秘密情报的含义,他强调的是制度中的行动执行者。美国总统是人民选出来的,组建了包括司法部在内的行政部门,司法部下辖FBI,作为联邦政府的调查性执行器,确保联邦法律在跨州、跨机构、跨权力边界的情境中能够被贯彻执行。

特工是代表FBI,自己策划和行动,来执行FBI维护联邦法律的宗旨。如果FBI没有授权,那么这个特工就失去了特工身份。同样的,最近在美国疯狂抓移民的ICE警察,也可以叫做agent。ICE警察既不秘密、也不搜集情报,但他同样是以ICE的授权为前提,以完成ICE为目标进行主动策划、行动的。

房产中介,是代表房东和买方的利益进行交易的代理人。

网络代理,是在网络中代替用户或系统执行操作的程序。

把以上的agent概念迁移到AI上,就出现了AI Agent。

我是非常反对把Agent翻译成智能体的。因为中文就没有一个词能涵盖agent这个概念,中文全是从完成的任务出发,没有一个词是从他的行动来源出发的词语。

英美的人们有一种习惯,就是大量思考和讨论制度框架,人们在制度框架中的具体行动和具体结果反而是无为的。

治理一个国家,是先写好国家宪法,但是并不是由统治阶层提前规定好每个人具体要做什么。所有人只要遵循这个宪法,个人可以各自追求自己的利益发挥主观能动性采取行动,最终呈现什么结果就是什么结果。

治理一个企业,也是先写好企业的章程,支出怎么决定,利润怎么分配,重大决策怎么投票,然后企业的参与方在这样的机制下充分发挥各自的优势给企业导入资源,让企业获得收入和利润,你认可这个机制愿意一起贡献就来,不愿意贡献就退出。

但是我们中国人习惯在具体任务上进行控制。经济可以被计划,分配也可以进行控制。这样就很难理解Agent这个词,因为Agent它就不对具体任务进行定义,就无法理解agent为什么需要是context、主动性和tool use的能力,而不是具体完成什么任务的一段程序。

我就想到了中国的基建为什么做得这么快,因为中国的决策是着重在要不要造铁路,怎么造铁路。如果分析下来造铁路是好的,那就去造。但是在欧美会遇到很多问题,包括保护公共利益跟私人利益的冲突,实际执行事情的时候,就会面临多个单位的冲突,各个单位单独好像又做不成事情。工程单位要等土地到位;地方议会作为民意机构,以反映民意为mandate,而不是推进建设促进经济增加税收;政府各个行政部门有自己的mandate,不能超越部门的。这种单位与单位之间的冲突,其实是被制度设计出来的制衡,能不能把事儿办了是次要的,制度是更重要的。中国人就看结果,这个事儿是不是好事儿,事办成后结果如何,怎么决策的不重要。

既然中文缺少对制度的重视,我们也还没找到特别好的翻译,那就先不翻译,既不要叫代理,也不要叫做智慧体,暂且还是称agent,待后人智慧吧。

So far, LLM仍然是在人类文明构建的语言中进行训练、学习,那么它的智能目前来说必然还是人类文明的次生产物,或者说他是投过人类语言的这个透镜对世界的理解。我并不是说他透过人类语言这个透镜对世界理解,他就不能够超越人类,不能做出创新。只是把以前的东西进行组合,也是创新的很重要的一种,甚至激进的说,所有的创新都是对现有东西的排列组合。只是说,他缺了明确的一环,他要自己去接触世界,而不要通过人类的透镜去接触世界。而接触世界的方式便是劳动和改造自然,跟人类一样。给AI以劳动和改造自然的工具,方才有世界模型。

智能哲学 Philosophy of Intelligence 系列:

- AI算不算真正的智能

- AI 会让律师这个行业消失吗?

- 更多决策,更少执行

- AI 时代的第一哲学问题:人类会被取代吗?

- AI 没有终点

- 迎接「智能浓缩」的时代

- 虚实之间的大小比较

- 智能哲学纲领

- 中国政府如何看待AI的二阶影响:就业与社保

- 语言概念的文化性,或者说非客观性

- 计划: 谁在支配谁

发表回复